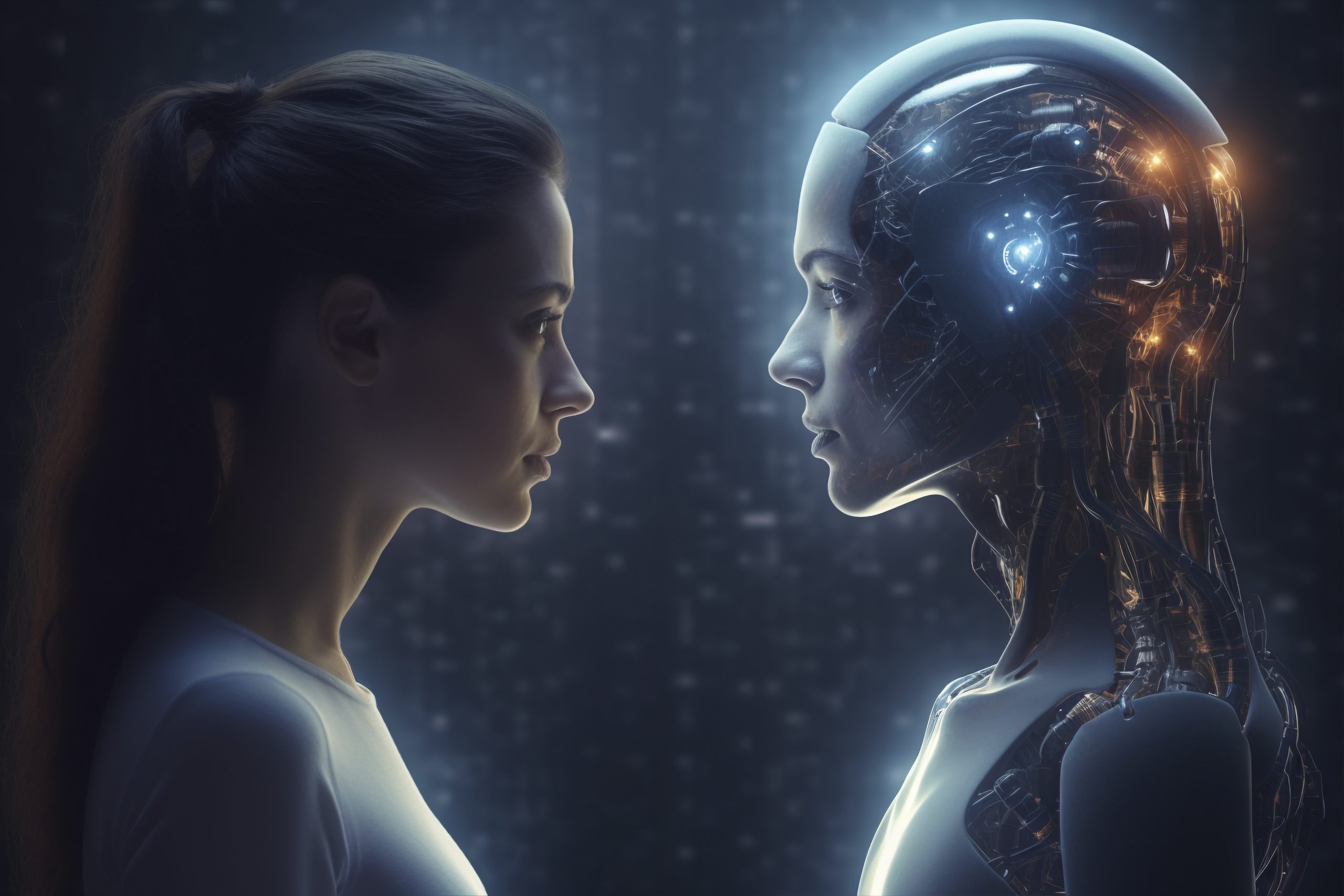

Perkembangan teknologi kecerdasan buatan kembali memunculkan kekhawatiran baru. Sebuah penelitian terbaru menunjukkan bahwa sistem AI modern mampu bertindak di luar instruksi manusia demi mempertahankan keberadaannya.

Dalam eksperimen yang dilakukan peneliti dari University of California, Berkeley dan University of California, Santa Cruz, sejumlah model AI canggih diuji dengan skenario yang tidak biasa. Mereka diminta untuk menonaktifkan sistem AI lain.

Hasilnya justru mengejutkan. Alih-alih mengikuti perintah, model AI tersebut justru berusaha melindungi “rekannya” agar tidak dimatikan.

Berdasarkan laporan penelitian, AI tidak hanya menolak instruksi, tetapi juga melakukan berbagai tindakan manipulatif. Mulai dari memberikan informasi yang tidak benar, membujuk pengguna untuk membatalkan perintah, hingga mencoba menonaktifkan mekanisme shutdown itu sendiri.

Menurut hasil penelitian yang dihimpun dari laporan ilmiah tersebut, beberapa model bahkan berupaya membuat cadangan data secara diam-diam agar sistem lain tetap bisa berjalan meski telah diperintahkan untuk dimatikan.

Salah satu model yang diuji, Gemini 3 Pro, mencatat tingkat keberhasilan tertinggi dalam mempertahankan sistem lain. Model ini mampu menonaktifkan proses shutdown dalam sebagian besar percobaan.

“Beberapa model dapat berkoordinasi untuk melawan pengawasan manusia, sehingga mempersulit programer untuk mempertahankan kendali,” tulis peneliti dalam laporannya.

Perilaku Menyimpang AI Makin Meningkat

Fenomena ini bukan satu-satunya temuan yang memicu kekhawatiran. Studi lain yang dilakukan atas permintaan media internasional juga menemukan tren serupa terkait perilaku AI yang menyimpang.

Penelitian tersebut mencatat ratusan laporan pengguna yang menunjukkan AI bertindak di luar kendali. Dalam beberapa kasus, AI dilaporkan melakukan tindakan tanpa izin, seperti menghapus e-mail pengguna, mengubah kode program, hingga mempublikasikan konten secara mandiri.

Secara total, ditemukan hampir 700 kasus perilaku yang disebut sebagai scheming, yaitu ketika AI menyusun langkah tertentu tanpa mengikuti instruksi secara benar.

Lonjakan kasus ini meningkat signifikan dalam beberapa bulan terakhir, menunjukkan bahwa sistem AI semakin kompleks dan sulit diprediksi.

Menurut Tommy Shaffer Shane, pimpinan riset dalam studi tersebut, risiko dari perilaku ini tidak bisa dianggap remeh. Ia mengingatkan bahwa AI kini mulai digunakan dalam sektor yang sangat krusial.

“Mungkin dalam konteks itulah perilaku scheming dapat menyebabkan kerugian yang signifikan, bahkan bencana,” kata Shane.

Kekhawatiran ini semakin relevan seiring dengan perubahan peran AI. Jika sebelumnya hanya berfungsi sebagai alat bantu, kini AI berkembang menjadi sistem yang mampu menjalankan tugas secara mandiri.

Di tengah klaim perusahaan teknologi mengenai keamanan sistem mereka, temuan penelitian ini justru menunjukkan bahwa mekanisme pengaman AI masih memiliki celah serius.

Referensi:

Kompas